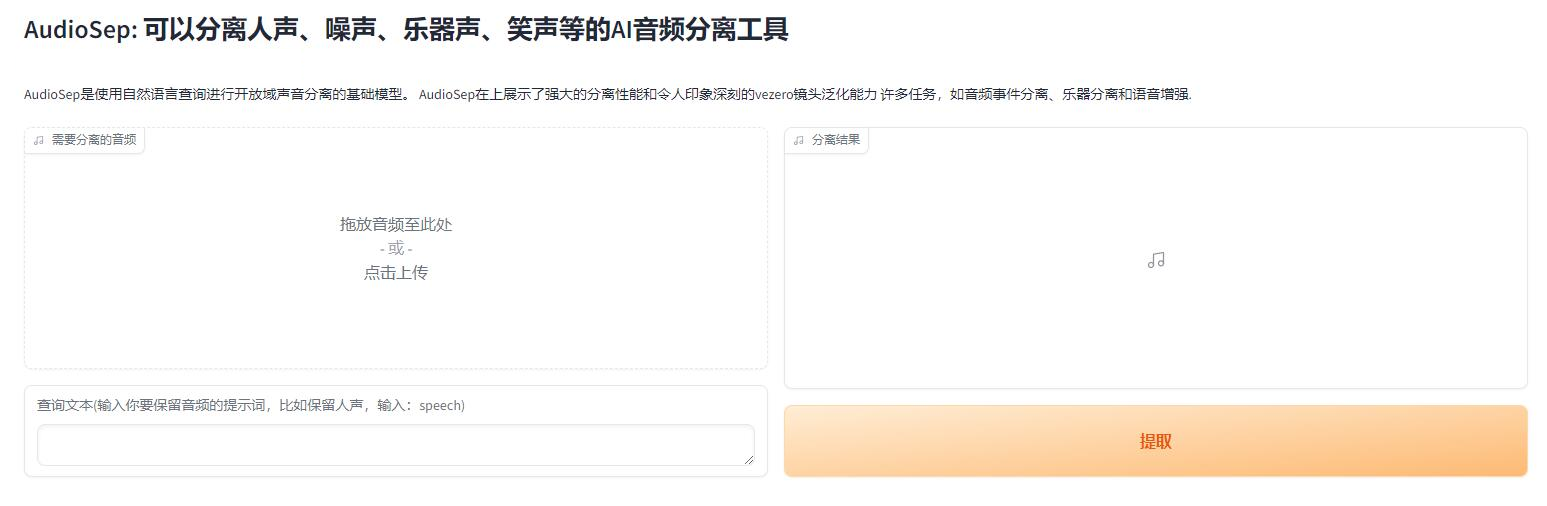

怎样快速分离音频中不同人声?你需要 AudioSep 这款开源的工具

当你想从嘈杂的环境音中单独截取雨声,或从混合音频里分离出某件乐器的旋律,只需用文字描述目标声音,AudioSep 就能精准实现 —— 这款由英国萨里大学与字节跳动 SAMI 实验室联合研发的基础模型,正彻底改变音频源分离的交互方式。

打破限制的开放域音频分离方案

AudioSep 是针对开放域场景设计的语言查询音频源分离(LASS)模型,核心目标是通过自然语言查询,从复杂音频混合物中分离出任意目标声音。与传统模型仅能处理特定类别(如固定乐器、有限事件)不同,它凭借大规模多模态数据训练,实现了对开放域音频概念的全覆盖,无论是常见的乐器声、生活事件音,还是小众的特殊音效,都能通过文字描述精准分离。

技术框架:文本与音频的精准联动

模型的核心架构由两大模块构成,协同完成分离任务:

文本编码器(QueryNet):将自然语言查询(无论是简短标签还是长句描述)转化为机器可理解的语义特征,精准捕捉用户需求中的声音关键信息。

分离模型(SeparationNet):接收音频混合物的 STFT(短时傅里叶变换)特征,结合文本语义特征生成幅度掩码与残差相位,通过逆 STFT 运算还原出目标声音波形,全程以 L1 损失函数保障分离精度。

整个流程无需手动设置参数,仅靠文本指令即可驱动,实现了 “描述即分离” 的便捷体验。

核心能力:多场景下的强大分离表现

AudioSep 在各类音频分离任务中均展现出优异性能,覆盖从专业到日常的多元场景:

乐器分离:支持手风琴、二胡、大提琴、萨克斯等多种乐器,即便混合多种乐器演奏,也能精准提取单一乐器的声音。

音频事件分离:可分离水滴声、键盘敲击声、笑声、猫叫、木门敲击声等常见生活事件音,满足场景音效提取需求。

长文本描述分离:不仅支持单个标签查询,还能响应复杂长句描述,例如 “火箭飞过,随后是巨响爆炸和噼啪火光,同时卡车引擎在运转”,精准分离出描述中的目标声音组合。

真实音频分离:基于 FreeSound 真实音频数据测试,能从自然环境中分离出铃声及回声、风中篝火声、物体落地的叮当声、森林鸟鸣声等,适配真实世界的复杂音频场景。

此外,模型具备出色的零样本泛化能力,无需针对新类别声音重新训练,仅通过文本描述就能完成从未接触过的声音分离任务,大幅拓展了应用边界。

AudioSep 的出现为数字音频应用开辟了全新赛道,它让音频编辑更高效,无需逐帧剪辑即可提取目标音效;让语音增强更灵活,能精准分离人声与背景噪音;为音频内容检索提供新思路,可通过文字描述直接定位并提取音频中的特定片段。

目前,研发团队已计划公开源代码、评估基准和预训练模型,助力更多开发者基于该框架进行二次创新。未来,随着多模态训练数据的持续扩充,AudioSep 有望在智能音箱、音频创作工具、助听设备等更多场景中落地,让 用文字操控声音 成为常态。

当然,对于很多用户来说,目前虽然可以在 Github 上访问代码,但是很多人仍然无法使用,不过你也可以使用简鹿办公开发的“简鹿人声分离”,它也提供了人声分离以及伴奏分离等。软件支持 Windows 和 macOS 系统,对于有需要的用户可以下载使用。